Google Gemini: un nuovo baluardo contro i deepfake e le immagini IA

Indice

- Introduzione: la minaccia dei deepfake e la risposta di Google

- Gemini e la svolta nel riconoscimento delle immagini IA

- Come funziona la tecnologia SynthID

- Limiti attuali: la verifica solo delle foto

- Estensioni future: Gemini e il riconoscimento dei video

- Implicazioni per la sicurezza digitale e la veridicità dell’informazione

- Gemini al servizio di terze parti e la democratizzazione della verifica

- Il ruolo della trasparenza algoritmica e la fiducia degli utenti

- Google e la lotta globale ai deepfake nel 2025

- Conclusioni

Introduzione: la minaccia dei deepfake e la risposta di Google

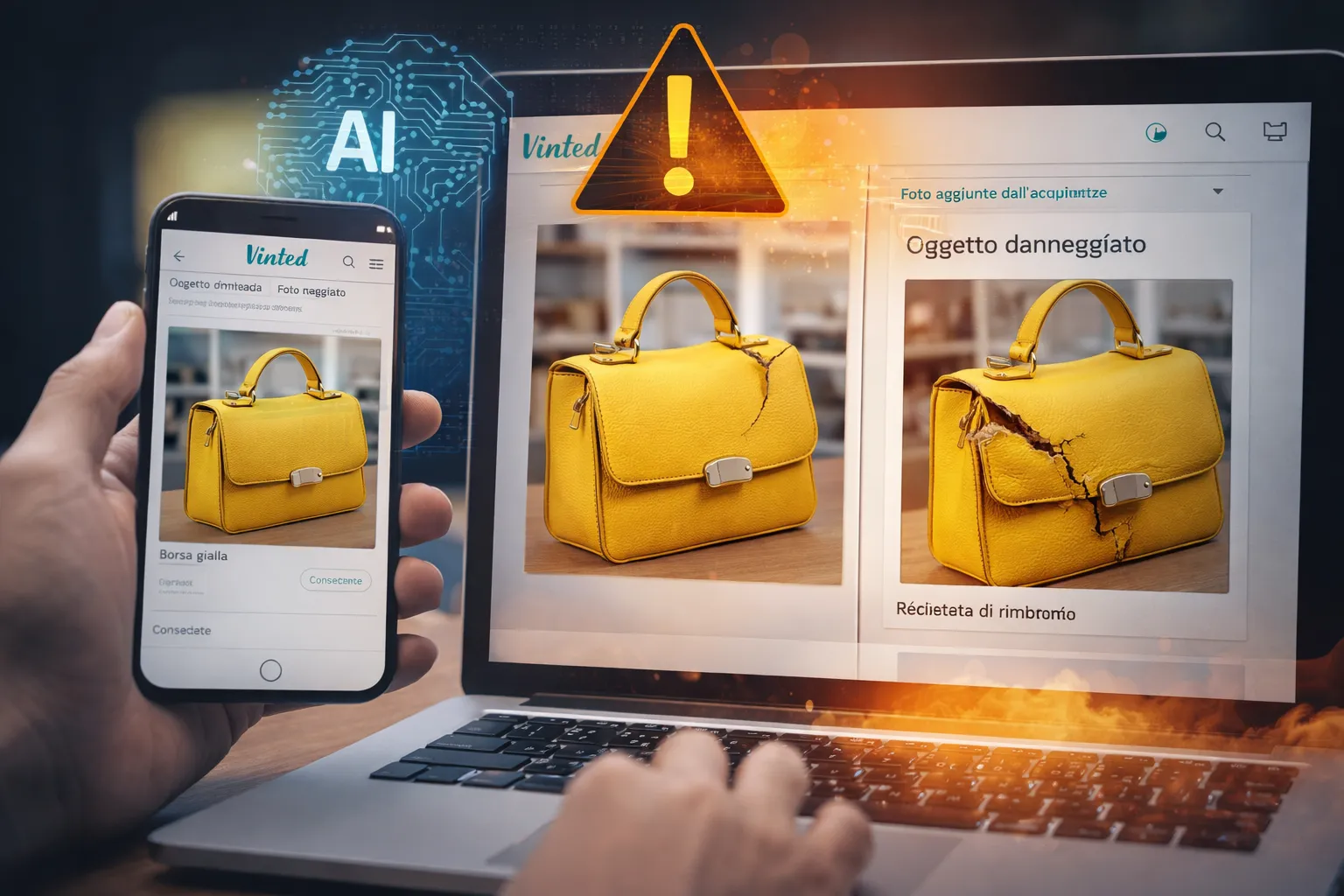

I deepfake rappresentano una delle principali sfide della società digitale contemporanea. Grazie all’evoluzione dell’IA generativa, falsificare immagini, video e persino suoni è diventato sempre più semplice e accessibile. Questi contenuti fake possono influire sull’opinione pubblica, minacciare la sicurezza personale e alimentare disinformazione su larga scala. Per arginare questo fenomeno, nel 2025 Google ha introdotto nuove capacità all’interno di Gemini, il suo avanzato sistema di intelligenza artificiale, rendendolo capace di riconoscere immagini create dall’intelligenza artificiale.

La nuova funzione si inserisce nel quadro delle iniziative contro la diffusione dei deepfake, rilanciando l’importanza della verifica delle informazioni digitali.

Gemini e la svolta nel riconoscimento delle immagini IA

Il cuore delle ultime novità riguarda l’integrazione della funzione di Gemini verifica foto fake. Gemini non si limita più solo alle funzioni di generazione e assistenza, ma si evolve in una vera e propria sentinella contro l’IA generativa riconoscimento adverso.

Questa nuova funzione si rivolge in particolare alla verifica delle fotografie. Usando SynthID Google, Gemini può ora determinare con precisione se una determinata immagine è il risultato di un processo di elaborazione artificiale oppure se si tratta di una fotografia autentica. Questa capacità è una risposta diretta alle pressanti richieste di aziende, istituzioni, media e cittadini, preoccupati dall’enorme mole di contenuti sintetici in circolazione.

Qual è la portata di questa innovazione?

Le fake news passano sempre più spesso attraverso immagini create artificialmente. La possibilità di sapere, in tempo reale e in modo affidabile, se una foto sia reale o generata dall’IA consente di rafforzare la resistenza collettiva contro la falsificazione digitale.

Come funziona la tecnologia SynthID

Gemini realizza la verifica dell’originalità delle immagini tramite SynthID, una tecnologia sviluppata internamente da Google e DeepMind. Il principio alla base è l’inserimento di una sorta di “filigrana” digitale invisibile alle immagini create dall’intelligenza artificiale. Ogni volta che un’immagine viene generata da Gemini, SynthID integra un’impronta unica, impossibile da riconoscere a occhio nudo ma facilmente rintracciabile dagli algoritmi di verifica.

- La filigrana non interferisce con la qualità visiva dell’immagine.

- Le impronte sono resistenti a ritagli, compressioni e altre manipolazioni comuni.

- Il controllo può essere effettuato istantaneamente da Gemini sulle immagini archiviate o condivise sulle piattaforme Google.

Secondo quanto dichiarato dagli sviluppatori di SynthID Google, questa soluzione rappresenta un vero scudo contro la contraffazione: permette sia il riconoscimento immediato di immagini generate dal proprio sistema, sia – potenzialmente in futuro – l’estensione del sistema anche a creazioni elaborate da altri algoritmi di IA generativa.

Valore aggiunto e limiti

La forza di SynthID non risiede solo nella filigrana ma anche nella costante evoluzione degli algoritmi di riconoscimento: Google aggiorna regolarmente il sistema in risposta alle contromosse degli sviluppatori di software per la manipolazione di immagini.

Limiti attuali: la verifica solo delle foto

Per il momento, la funzionalità di verifica di Gemini è limitata alle sole immagini statiche. In altre parole, il sistema non è ancora in grado di analizzare e riconoscere come deepfake i video realizzati con strumenti IA. Questa decisione deriva principalmente dalla complessità tecnica: un video è composto da migliaia di frame e l'applicazione di SynthID o tecnologie simili richiede una notevole potenza di calcolo, nonché una strategia per evitare che la filigrana venga persa o alterata durante la compressione e la condivisione su piattaforme diverse.

Nonostante questa limitazione, l’attuale verifica immagini AI Google è già un’importante passo avanti. L’implementazione di Gemini in questo contesto anticipa tendenze che, secondo gli esperti, si consolideranno rapidamente nei prossimi anni.

Estensioni future: Gemini e il riconoscimento dei video

La lotta ai deepfake, però, non si ferma alle fotografie. Google ha annunciato di essere al lavoro sull'estensione delle capacità di Gemini alla verifica dei video. Questo progetto rappresenta una vera e propria rivoluzione nell’ambito della sicurezza digitale, perché i video sono oggi tra i mezzi più perniciosi per la diffusione di informazioni false.

L’obiettivo è – a medio termine – dotare Gemini di un sistema in grado di

- analizzare frame per frame le sequenze video

- individuare filigrane anche su immagini in movimento

- segnalare ai fruitori e ai moderatori la provenienza e la natura dei contenuti

Anche in questo caso, la sfida non è solo tecnica ma anche etica: i sistemi di controllo dovranno garantire la privacy degli utenti, la tutela dei dati e la trasparenza delle modalità con cui vengono marcate e riconosciute le immagini e i video.

Implicazioni per la sicurezza digitale e la veridicità dell’informazione

La possibilità di verificare se una foto, o in futuro un video, sia stata creata mediante intelligenza artificiale ha profonde implicazioni:

- Maggiore sicurezza per utenti, aziende e istituzioni: la possibilità di smascherare contenuti fake riduce il rischio di truffe, diffusioni di notizie false o danni reputazionali.

- Più responsabilità per chi crea e condivide contenuti: sapere che il materiale verrà verificato incentiva un comportamento più etico e rispettoso delle regole della community sia sugli strumenti Google che sul web.

- Tutela della verità e dell'autenticità: l’utente può sempre più facilmente distinguere tra contenuto reale e generato, salvaguardando i principi di veridicità nell’informazione digitale.

Il ruolo della formazione digitale

Questa innovazione, però, non può prescindere dall’educazione: la presenza di strumenti avanzati deve andare di pari passo con la crescita della consapevolezza individuale e collettiva nella lettura critica dei contenuti online. Educatori e istituzioni scolastiche dovranno aggiornare i programmi di media literacy per includere anche competenze sul riconoscimento dei segnali di manipolazione e sull’uso consapevole delle tecnologie di verifica.

Gemini al servizio di terze parti e la democratizzazione della verifica

Un altro aspetto fondamentale è la possibilità di estendere la tecnologia di verifica anche a servizi di terze parti. Google ha annunciato che, dopo le fasi iniziali di rodaggio, Gemini contro deepfake e SynthID potranno essere messi a disposizione di altre piattaforme digitali.

Questa apertura crea le basi per un approccio più inclusivo e democratico nella lotta alla disinformazione. Servizi giornalistici, agenzie di fact-checking, piattaforme social e altri operatori potranno integrare la funzione come riconoscere immagini AI nei loro workflow quotidiani.

Benefici per l’ecosistema digitale

- Maggiore collaborazione nella lotta alla falsificazione digitale.

- Ampliamento della rete di rilevamento dei contenuti IA.

- Uniformità di standard tra piattaforme diverse.

- Rafforzamento della fiducia nell'intero ecosistema digitale.

Il ruolo della trasparenza algoritmica e la fiducia degli utenti

Affinché le nuove tecnologie siano accolte con favore, è indispensabile un elevato grado di trasparenza. Google ha pubblicato documentazione dettagliata su come viene implementato SynthID e sui criteri di riconoscimento impiegati da Gemini. Questo consente agli esperti e ai partner di comprendere e, se necessario, verificare i metodi utilizzati. Atteggiamenti opachi o poco chiari alimenterebbero una diffidenza che, nel delicato settore della sicurezza digitale, rischia di compromettere anche i migliori strumenti.

Gli utenti devono essere informati quando un contenuto risulta manipolato o generato dall’IA. È quindi in corso anche una riflessione, a livello normativo e internazionale, sull’opportunità di introdurre avvisi espliciti sulle piattaforme che utilizzano la tecnologia di rilevamento: pop-up, badge, o etichette visibili.

Google e la lotta globale ai deepfake nel 2025

Nel panorama della Google lotta deepfake 2025, l’azienda di Mountain View vuole porsi come leader tecnologico e morale. Negli ultimi anni, la competizione tra i colossi digitali si è fatta sempre più intensa, sia sul fronte della generazione di contenuti che su quello della lotta agli abusi. Google offre alle istituzioni pubbliche e private, agli operatori dell’informazione e ai cittadini, strumenti concreti per difendersi, nella consapevolezza che nessun filtro sarà mai risolutivo senza un impegno collettivo.

Iniziative internazionali e partnership

Google collabora con governi, organizzazioni internazionali e gruppi di ricerca per condividere best practice, aggiornare le difese e sviluppare standard comuni. Solo una risposta coordinata può arginare la diffusione dei deepfake e dei contenuti IA fraudolenti su scala planetaria.

Conclusioni

In questo scenario sempre più rischioso, la mossa di Google di arricchire Gemini con funzioni di verifica immagini AI Google e, a breve, dei video, rappresenta un investimento strategico su più piani: tecnologico, etico, sociale.

La diffusione dei deepfake continuerà a crescere. Tuttavia, grazie a strumenti come SynthID e Gemini verifica foto fake, cittadini, imprese e istituzioni possono affrontare le nuove sfide con maggiore sicurezza e responsabilità. Sarà essenziale, in questa fase di transizione, promuovere la cultura digitale, la trasparenza e la collaborazione internazionale affinché la realtà sopravviva e prevalga sulla mistificazione.

La lotta ai deepfake e alle manipolazioni digitali è solo all’inizio. Con iniziative come quelle annunciate da Google a novembre 2025, l’informazione digitale fa un passo importante verso una maggiore tutela della verità e dell’affidabilità.